PyTorch终于能用上谷歌云TPU,推理性能提升4倍,我们该如何薅羊毛?

晓查 发自 凹非寺

量子位 报道 | 公众号 QbitAI

昨天,Facebook在PyTorch开发者大会上正式推出了PyTorch 1.3,并宣布了对谷歌云TPU的全面支持,而且还可以在Colab中调用云TPU。

之前机器学习开发者虽然也能在Colab中使用PyTorch,但是支持云TPU还是第一次,这也意味着你不需要购买昂贵的GPU,可以在云端训练自己的模型。

而且如果你是谷歌云平台(Google Cloud Platform)的新注册用户,还能获得300美元的免费额度。

现在PyTorch官方已经在Github上给出示例代码,教你如何免费使用谷歌云TPU训练模型,然后在Colab中进行推理。

训练ResNet-50

PyTorch先介绍了在云TPU设备上训练ResNet-50模型的案例。如果你要用云TPU训练其他的图像分类模型,操作方式也是类似的。

在训练之前,我们先要转到控制台创建一个新的虚拟机实例,指定虚拟机的名称和区域。

如果要对Resnet50在真实数据上进行训练,需要选择具有最多CPU数量的机器类型。为了获得最佳效果,请选择n1-highmem-96机器类型。

然后选择Debian GNU/Linux 9 Stretch + PyTorch/XLA启动盘。如果打算用ImageNet真实数据训练,需要至少300GB的磁盘大小。如果使用假数据训练,默认磁盘大小只要20GB。

创建TPU

- 转到控制台中创建TPU。

- 在“Name”中指定TPU Pod的名称。

- 在“Zone”中指定云TPU的区域,确保它与之前创建的虚拟机在同一区域中。

- 在“ TPU Type”下,选择TPU类型,为了获得最佳效果,请选择v3-8TPU(8个v3)。

- 在“ TPU software version”下,选择最新的稳定版本。

- 使用默认网络。

- 设置IP地址范围,例如10.240.0.0。

官方建议初次运行时使用假数据进行训练,因为fake_data会自动安装在虚拟机中,并且只需更少的时间和资源。你可以使用conda或Docker进行训练。

在fake_data上测试成功后,可以开始尝试用在ImageNet的这样实际数据上进行训练。

用conda训练:

# Fill in your the name of your VM and the zone.

$ gcloud beta compute ssh "your-VM-name"--zone "your-zone".

(vm)$ exportTPU_IP_ADDRESS=your-ip-address

(vm)$ exportXRT_TPU_CONFIG= "tpu_worker;0;$TPU_IP_ADDRESS:8470"

(vm)$ ulimit-n 10240

(vm)$ conda activate torch-xla-0.5

(torch-xla-0.5)$ python /usr/share/torch-xla-0.5/pytorch/xla/ test/test_train_imagenet.py --datadir=~/imagenet --model=resnet50 --num_epochs=90 --num_workers=64 --batch_size=128 --log_steps=200

用Docker训练:

# Fill in your the name of your VM and the zone.

$ gcloud beta compute ssh "your-VM-name"--zone "your-zone".

(vm)$ exportTPU_IP_ADDRESS=your-ip-address

(vm)$ docker run --shm-size 128G -v ~/imagenet:/tmp/imagenet -e XRT_TPU_CONFIG= "tpu_worker;0;$TPU_IP_ADDRESS:8470"gcr.io/tpu-pytorch/xla:r0.5 python3 pytorch/xla/ test/test_train_imagenet.py --model=resnet50 --num_epochs=90 --num_workers=64 --log_steps=200 --datadir=/tmp/imagenet

在n1-highmem-96的虚拟机上选用完整v3-8 TPU进行训练,第一个epoch通常需要约20分钟,而随后的epoch通常需要约11分钟。该模型在90个epoch后达到约76%的top-1准确率。

为了避免谷歌云后续进行计费,在训练完成后请记得删除虚拟机和TPU。

性能比GPU提升4倍

训练完成后,我们就可以在Colab中导入自己的模型了。

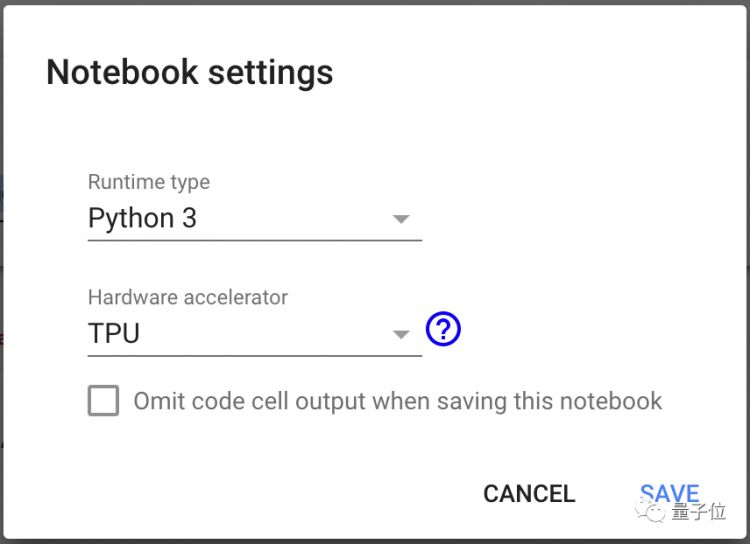

打开notebook文件,在菜单栏的Runtime中选择Change runtime type,将硬件加速器的类型改成TPU。

先运行下面的代码单元格,确保可以访问Colab上的TPU:

importos

assertos.environ[‘COLAB_TPU_ADDR’], ‘Make sure to select TPU fromEdit > Notebook settings > Hardware accelerator’

然后在Colab中安装兼容PyTorch/TPU组件:

DIST_BUCKET= "gs://tpu-pytorch/wheels"

TORCH_WHEEL= "torch-1.15-cp36-cp36m-linux_x86_64.whl"

TORCH_XLA_WHEEL= "torch_xla-1.15-cp36-cp36m-linux_x86_64.whl"

TORCHVISION_WHEEL= "torchvision-0.3.0-cp36-cp36m-linux_x86_64.whl"

# Install Colab TPU compat PyTorch/TPU wheels and dependencies

!pip uninstall -y torch torchvision

!gsutil cp "$DIST_BUCKET/$TORCH_WHEEL".

!gsutil cp "$DIST_BUCKET/$TORCH_XLA_WHEEL".

!gsutil cp "$DIST_BUCKET/$TORCHVISION_WHEEL".

!pip install "$TORCH_WHEEL"

!pip install "$TORCH_XLA_WHEEL"

!pip install "$TORCHVISION_WHEEL"

!sudo apt-get install libomp5

接下来就可以导入你要训练好的模型和需要进行推理的图片了。

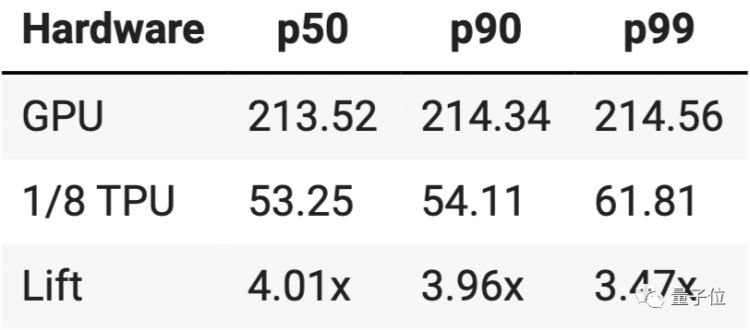

在PyTorch上使用TPU对性能的提升到底有多明显呢?官方选用了v2-8的一个核心,即1/8 TPU的情形,与使用英伟达Tesla K80 GPU进行对比,实测显示推理时间大大缩短,性能约有4倍左右的提升。

GitHub地址:

https://github.com/pytorch/xla/tree/master/contrib/colab

作者系网易新闻·网易号“各有态度”签约作者

— 完—

大会启幕!预见智能科技新未来

量子位MEET 2020智能未来大会启幕,将携手优秀AI企业、杰出科研人员呈现一场高质量行业盛会!详情可点击图片:

榜单征集!三大奖项,锁定AI Top玩家

2019中国人工智能年度评选启幕,将评选领航企业、商业突破人物、最具创新力产品3大奖项,并于MEET 2020大会揭榜,欢迎优秀的AI公司扫码报名!

量子位 QbitAI · 头条号签约作者

վ'ᴗ' ի 追踪AI技术和产品新动态

喜欢就点「好看」吧 !

相关文章

-

马云、刘强东、丁磊,竟都盯上了养猪生意

-

罚款160万元!“人脸识别”抢客户?行不通

-

科技神回复|马云今日卸任阿里董事局主席,但他依然是我的债主

-

春晚10亿春节近20亿!央视春晚百度红包攻略来啦

-

考BIM证书有用吗?拿到证书后,可以做什么,薪资前景如何?

-

美国抵制华为计划出现“裂痕”,5G的“魅力”终究无法抵挡

-

马大个素人网红孵化课视频MP4格式,价值辨别减少试错成本

-

守擂6.18成功,京东凭什么?2次疫情“重塑”的电商

-

直播平台纷纷进军在线教育虎牙到底有哪些优势?

-

苹果WWDC2020官宣改为线上举行!31年来首次

-

开局一把“屠龙刀”,熊猫直播没玩好,倒闭都是王思聪的错?

-

苹果搜索广告ASA已可在中国大陆地区AppStore正式投放

-

系统集成商在开发和推出工业4.0解决方案中的作用

-

过时的QQ被00后玩出新花样,看不懂“扩列”的你已经老了

-

“区块链”+“物联网”成天作之合?12大落地场景解密【附下载】|智东西内参

-

QQ再也不是我的小甜甜了

-

京东被曝将淘汰10%高管假"裁员"还是真"反腐"?

-

阿里组织架构再调整,核心在于通则不痛

-

恩智浦主动抛出“绣花球”华为何不把其纳入麾下?

-

腾讯向老干妈致歉:双方已厘清误解,未来将正式合作|钛快讯

-

知名程序员BradFitzpatrick离职谷歌,告别Go语言团队

-

专访阿里巴巴段玲:买到就是赚到的 88VIP 会员是如何诞生的?

-

胡玮炜辞任摩拜CEO后,出任WKUP单车董事

-

谁也没猜透的单车结局:ofo摩拜未合并,哈啰反骑到头上了

-

微信 8 周年!今天是它陪伴你的第几天?

-

一加7Pro高清渲染图曝光:无刘海全面屏

-

乡村教师:陪伴,是对故乡的告白

-

五大云巨头:亚马逊称霸全球,阿里云能追赶AWS吗?

-

京东白条被锁定多久会恢复