不仅教人穿衣服,还要给人换衣服:这两篇ICCV论文出自同一人

乾明 假装发自 首尔

量子位 报道 | 公众号 QbitAI

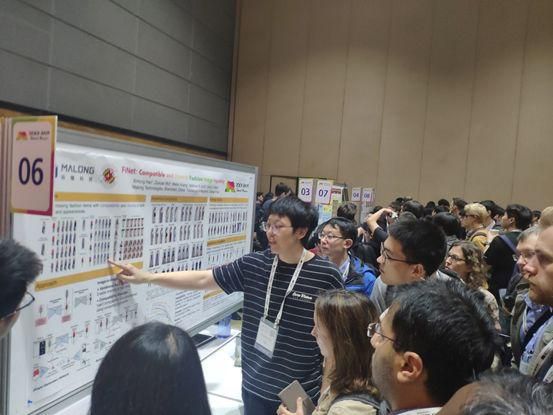

人在ICCV 2019,刚从韩国首尔离开。【doge

说两篇有意思的论文吧,来自一个中国小哥,都是关于“衣服”的研究。

一篇教人穿衣服,另一篇给人换衣服。

比脱衣服的研究难多了,而且颇具商业价值。

第一篇教人穿衣服:FiNet模型

这篇论文题目为Compatible and Diverse Fashion Image Inpainting,还被接收为Oral论文(接受率仅4.6%),研究方向是时装搭配。

研究到了这个程度,只是简单地将输入图像中缺失的时尚单品补全已经不够用了。

想要突出还要注重整体搭配的协调性与真实性。

在这个过程中,最棘手的一个问题是,如何在耦合形状和外观时,妥善处理衣服的边界。

这也是同类模型效果不如人意,且无法商业化的关键点之一。

这个论文中,作者提出了一个名为FiNet的模型,基于两阶段的变分自编码器的生成网络,在满足多样性和兼容性的条件下,来填充图像中缺失的时尚商品。

核心思路是,分别用形状生成网络和外观生成网络,来依次生成缺失衣服的形状和外观。

从而使FiNet可以在目标区域中修复出具有不同形状和外观的服装。

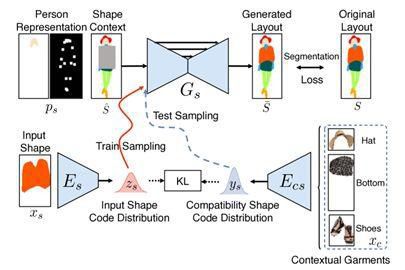

△形状生成网络

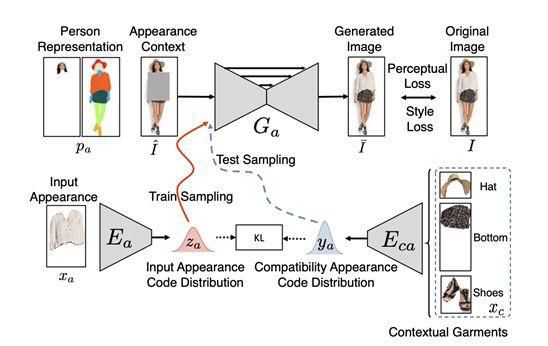

△外观生成网络

为了保证兼容性,作者也在其中集成了一个兼容性模块,将兼容性信息编码到网络中,来保证让生成衣服的形状和外观都是和其他衣服是兼容搭配的。

如此研究,应用场景也颇为广泛。

从用户的角度来说,在不知道穿什么衣服出门的时候,可以让计算机模型自动生成搭配的潮流服装。

而商家,则是可以将这一技术,应用到时装设计和新时尚商品推荐等应用中,来更好的实现商业购买转化,进一步激发用户的消费力。

那效果如何呢?在论文中,作者给出的效果是这样的:

直观来看,与Pix2Pix+noise、BicyleGAN、VUNET、ClothNet等方法相比,效果比较好。

从实际应用的角度来分析,FiNet模型的结果,也相对更接近落地一些。

论文地址:

FiNet:Compatible and Diverse Fashion Image Inpainting

https://arxiv.org/abs/1902.01096v2

第二篇:给人换衣服,ClothFlow模型

这篇论文名为ClothFlow: A Flow-Based Model for Clothed Person Generation,研究主题也是衣服生成。

但与FiNet模型比起来,这篇论文的实现方式与应用方向都有很大不同。

ClothFlow是一个基于外观流的衣服生成模型。

主要用于将一个图片中的服装渲染到另外一张图片上,其想要实现的效果是这样的:

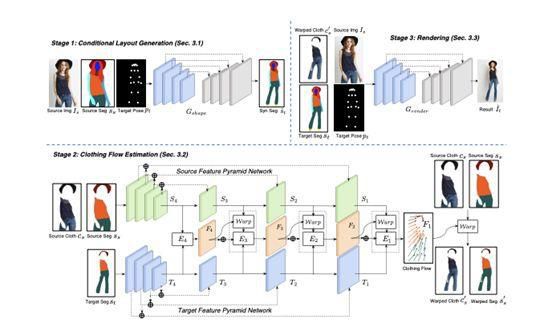

具体的实现方式,是使用一个级联的特征金字塔网络,估算源服装区域和目标服装区域的几何变换,然后通过多个基于编码器-解码器的生成网络来实现“衣服迁移”。

在论文中,作者也多次提到了这一研究的应用场景——虚拟试衣等服装相关应用。

尤其是在直播场景中,有不少的想象空间。

这一技术成熟后,主播可以虚拟换装,省去买衣服的成本和换衣服的时间。

而且, 用户也可以根据自己的喜好给主播选穿什么样的衣服。

论文地址:

ClothFlow: A Flow-Based Model for Clothed Person Generation

http://openaccess.thecvf.com/content_ICCV_2019/papers/Han_ClothFlow_A_Flow-Based_Model_for_Clothed_Person_Generation_ICCV_2019_paper.pdf

作者

最后简单介绍下论文作者吧。

主题相近、方法不同的两篇入会论文,一作都是一位叫韩欣彤的小哥。

随手查了下履历:

上海交大本科、马里兰大学帕克分校博士。

2018年进入工业界,先在创业公司码隆科技任职算法研究员。

最新已被挖到虎牙,是中国直播一哥公司的计算机视觉Tech Lead。

他说,接下来还是会持续关注直播内容生成方向,比如人脸和人体的驱动和生成。

韩欣彤很年轻,但已经在CVPR,ICCV,ECCV等顶级会议发表了近十篇论文。

而且据他自己介绍,是上海交大本科三年级时才真正接触计算机视觉,至今7年。

所以也是真正找到了兴趣和擅长,也赶上了时代潮流。

我们问虎牙,这次韩欣彤博士穿衣服、换衣服的研究,会跟他现在在虎牙的工作进一步相关起来吗?

比如——一个大胆而规矩的想法,在直播中给主播虚拟换装,或者让用户给主播换衣服。

他们没给直接肯定的答案。

不过也云山雾罩透露:在学在产,虎牙的技术研发都不会仅仅存在于论文中,也会进一步进入到平台业务中。

所以,就说你们这些搞技术研究的,赞得很。(大误)

— 完 —

相关文章

-

OPPO手机拍照没有声音怎么办

-

实操干货:提升短信营销ROI,这3个方面是重点

-

小米新机曝光:小米Max4和小米9即将来临,雷军终于要出手了!

-

芯片产业缺人才?梁孟松的薪资说明一切,任正非的方法值得学习!

-

融360|简普科技叶大清荣获“2018中国社会责任影响力人物”

-

庆安二小培育百名小小红色宣讲员

-

Snapchat:我一个社交平台,竟然被你当相机玩?

-

[观点]华泰证券:高新兴正在深度转型是更懂5G的车联网公司

-

京东与吉利控股达成战略合作,涉及物流、商用车技术赋能等领域

-

iphone12怎么显示网速

-

【虎嗅早报】百度新闻负责人回应假账号:团队管理是核心问题;孙宇晨:拿1000万元支持对小鹏汽车进行维权

-

最高一日三送,苏宁易购把握到家业务爆发期

-

大咖说|明星下沉、总裁破圈,直播的36个侧面

-

米兔儿童电话手表怎么添加联系人

-

鼠标终将消失,未来我们有哪些人机交互方式?

-

终于等到你!腾讯微信安卓内测版发布:支持暗黑模式

-

微信和QQ终于能互通了?可是微信和QQ的缺点让用户难以忍受

-

旺旺变了!卖衣服,卖小馒头沙发,还计划和天猫开发新品

-

央视春晚独家合作伙伴,为什么今年会是百度?

-

苹果宣布:启动Mac和iOS通用购买功能

-

特斯拉组建中国技术团队,上海工厂首辆白车身已下线

-

短视频会反噬综艺吗?

-

发挥工业互联网的支撑引领作用

-

破局数字教育:与出行、物流领域“同出一辙”,铺平最后一公里?

-

腾讯凭什么拥抱产业互联网?

-

女子带一物品上鉴宝节目,自称是拿房子换来的,专家说:眼力独到!

-

上海短视频代运营:如何通过抖音将精准客户引流到店呢?

-

千乘资本熊伟:2019年产业互联网不会爆发

-

无纸化——文旅服务向数字化协同靠拢